Guide du journaliste pour détecter les contenus générés par l’IA

A mesure que la mésinformation rattrape l’information factuelle, il devient pratiquement impossible de distinguer le vrai du faux. Ce guide montre aux journalistes comment ils peuvent essayer d’identifier les contenus générés par l’IA dans des délais très serrés. Nous vous proposons sept catégories de moyens de détection avancée que tout journaliste se doit de maîtriser.

Mon travail consiste à aider les rédactions à lutter contre la mésinformation, et ce qui m’empêche de dormir, c’est que la vérification traditionnelle des faits prend des heures, voire des journées entières, alors qu’il ne faut que quelques minutes pour générer de la mésinformation avec l’IA.

La mésinformation par vidéo existe depuis longtemps. Elle a précédé de plusieurs décennies la technologie moderne d’IA. Malgré les techniques limitées du matériel de l’époque, elle pouvait donner de fausses impressions aux effets parfois dévastateurs. En 2003, une assistante maternelle, Claudia Muro, a été arrêtée et a passé près de deux ans et demi en prison parce qu’une caméra de surveillance à faible fréquence d’image avait donné l’impression que ses mouvements étaient violents. Personne n’avait eu l’idée de vérifier ces images. En janvier 2025, une enseignante, Cheryl Bennett, a été obligée de se cacher après qu’une infox vidéo a laissé croire, à tort, qu’elle tenait des propos racistes.

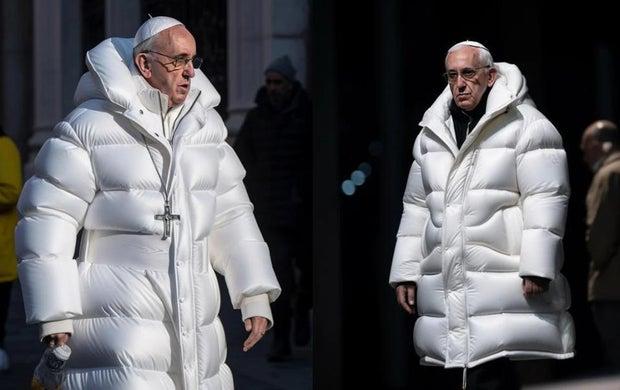

Image générée par l’IA censée représenter le Pape François en doudoune Balenciaga. Image : Midjourney, Pablo Xavier

Cette image virale du Pape François en manteau blanc Balenciaga a berné des millions de personnes sur les réseaux sociaux, avant que l’on apprenne qu’elle avait été générée par l’IA en utilisant le prompt d’image de Midjourney. Parmi les principaux indices qui permettaient de détecter la supercherie, on notera la croix, autour du cou, qui défie les lois de la gravité, inexplicablement, n’étant maintenue que par une moitié de chaîne. Le créateur de l’image, Pablo Xavier, a déclaré à BuzzFeed News : « Je trouvais juste amusant de voir le Pape dans une drôle de veste".

Les faux les plus réalistes ne nécessitent pas forcément de recourir à l’IA. En mai 2019, une vidéo de Nancy Pelosi, la présidente de la Chambre des représentants, aux Etats-Unis, a été ralentie pour atteindre une vitesse de 75 %, et sa tonalité modifiée pour donner l’impression qu’elle était alcoolisée. De même, en novembre 2018, la Maison blanche a partagé une version accélérée de l’interaction entre un journaliste de CNN, Jim Acosta, et une stagiaire de la Maison blanche, laissant penser que le mouvement de son bras avait été plus agressif qu’il ne l’avait été en réalité.

Récemment, j’ai moi-même créé un faux scandale politique avec son cortège habituel de présentateurs télé, de citoyens outrés, d’images de manifestations, et même avec un maire fictif, et cela en 28 minutes chrono, pendant ma pause déjeuner. Coût total de l’opération : huit dollars. Moins de 30 minutes pour une crise politique montée de toutes pièces, à même de duper des responsables éditoriaux qui ne savent pas où donner de la tête et qui ont des délais extrêmement serrés à respecter.

Il n’y a pas si longtemps, j’ai vu une personne qui s’y connaît pourtant en matière de vérification des faits, assurer qu’une image générée par l’IA était « authentique" parce qu’on y voyait une main à cinq doigts et non à six. Mais un tel argument ne tient plus aujourd’hui.

C’est la dure réalité de la détection de l’IA : les méthodes qu’on croyait fiables se volatilisent sous nos yeux. Au tout début de la mise au point des générateurs d’images par l’IA, des mains mal dessinées — des doigts supplémentaires, ou des doigts fusionnés, par exemple — étaient monnaie courante, et elles trahissaient souvent des images générées par l’IA. De fausses images virales, comme celles de l’arrestation supposée de Trump en 2023, ont pu en partie être détectées grâce à ces erreurs évidentes. Mais en 2025, des logiciels d’IA majeurs comme Midjourney et DALL-E se sont beaucoup améliorés pour générer des mains parfaites au niveau anatomique. Par conséquent, il ne suffit plus d’examiner les mains pour détecter des images générées par l’IA, et les journalistes qui cherchent à identifier un contenu généré par l’IA doivent rechercher d’autres signes plus subtils.

La révolution en termes de rendu de texte a été encore plus rapide. Il fut un temps où les pancartes brandies par des manifestants affichaient des messages erronés, comme “STTPO THE MADNESSS” et “FREEE PALESTIME”, mais certains des modèles actuels ne font aucune faute. OpenAI a entraîné DALL-E 3 sur l’exactitude de texte, tandis que Midjourney V6 a ajouté “texte correct” à sa liste d’atouts. Une méthode de détection fiable par le passé ne fonctionne aujourd’hui que rarement.

Des oreilles mal alignées, des yeux anormalement asymétriques et des dents créées avec MS Paint ou un autre éditeur d’images étaient caractéristiques, il y a quelque temps, des visages générés par l’IA, mais sont maintenant de plus en plus rare. Les images de portraits générés en janvier 2023 comportaient des ratés détectables facilement. Les mêmes prompts d’image produisent aujourd’hui des visages réalistes.

Cela représente un très grand danger pour les rédactions. Un journaliste formé en 2023 aux méthodes de détection peut être, à tort, sûr de lui, et affirmer qu’un contenu de toute évidence généré par l’IA est authentique, pour la seule et unique raison que ce contenu a passé avec succès des tests obsolètes. Une telle certitude, qui n’a pas lieu d’être, est plus dangereuse que le doute.

Je vous présente Image Whisperer

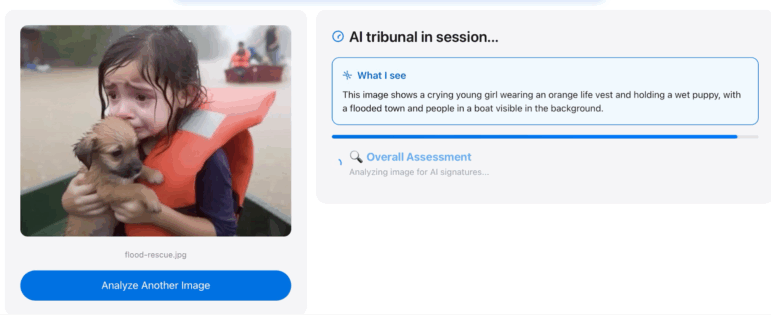

Analyse d’une image générée par l’IA censée représenter une fillette secourue suite à des inondations aux Etats-Unis. Image : Henk van Ess

Je me suis demandé si je pouvais créer un outil d’identification de contenus générés par l’IA, au-delà du présent article. J’ai commencé par contacter des experts. Ils m’ont immergé au plus profond d’un domaine de la physique que je n’imaginais pas : transformations de Fourier, mécanique quantique de réseaux neuronaux, signatures mathématiques invisibles à l’œil humain. Un physicien m’a expliqué en quoi les artefacts de l’AI ne sont pas seulement des dysfonctionnements visuels. Ce sont des signatures de domaines fréquentiels.

Puis je suis revenu à la réalité. « N’essayez pas de créer un outil par vous-même", m’a averti un expert. « Il vous faudrait une puissance informatique énorme et des équipes de niveau doctoral. Sans cela, votre projet serait voué à l’échec ».

C’est à ce moment-là que j’ai eu une révélation. Pourquoi ne pas lutter contre l’IA avec l’IA, mais différemment ? Plutôt que de recréer des systèmes de détection qui coûtent des milliards de dollars, j’allais exploiter les infrastructures d’IA existantes pour faire l’essentiel du travail.

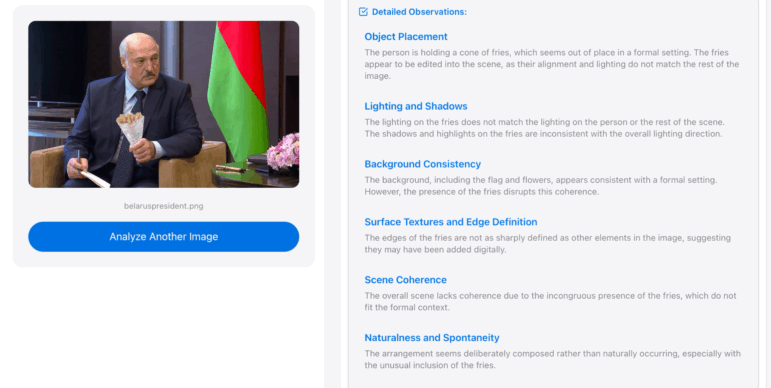

Analyse d’une image générée par l’IA censée représenter le président de la Biélorussie, un cornet de frites à la main. Image : Henk van Ess

C’est ainsi qu’Image Whisperer (initialement appelé Detectai.live) a vu le jour. Cet outil effectue une analyse de modèle de langage en parallèle de Google Vision, en appliquant les principes de physique que ces experts m’ont enseignés, tout en exploitant la puissance informatique déjà disponible. Surtout, contrairement à la plupart des outils d’IA, Image Whisperer vous informe quand il ne sait pas, plutôt que de vous faire croire qu’il a la réponse.

Il n’a pas pour ambition d’être le meilleur système au monde, mais d’être le plus honnête.

Sept moyens de détection d’un contenu généré par l’IA

La course à l’armement entre les créateurs et les détecteurs d’IA se poursuit. Les créateurs ont actuellement l’avantage de la rapidité. Déterminer s’il s’agit ou non d’une infox est en train de devenir un jeu du chat et de la souris, à mesure que les concepteurs améliorent la technologie. Pour parvenir à identifier une infox, il faut combiner plusieurs méthodes de détection, faire preuve d’une vigilance constante, et accepter le fait qu’une détection parfaite n’existe pas. Pour les journalistes qui cherchent des réponses précises, le but, désormais, n’est plus d’identifier les fakes de manière irréfutable, mais d’évaluer la probabilité d’un fake et de se forger un jugement averti.

Nous, les journalistes, nous sommes toujours adaptés à l’évolution de la technologie. Nous avons appris à vérifier nos sources depuis que tout le monde est en capacité de créer un site. Nous avons mis au point des protocoles de vérification des réseaux sociaux quand tout un chacun est devenu un journaliste potentiel. Nous devons à présent élaborer des outils pour cette nouvelle ère où n’importe qui peut créer des “preuves” audiovisuelles convaincantes.

Catégorie 1 : ratés visuels (anatomie ou objets) — Quand la perfection devient un indice

Vérification urgente en 30 secondes (infos de dernière minute) : Quand vous disposez de très peu de temps et que vous devez apprécier en un instant une image à la perfection suspecte, concentrez-vous sur votre intuition quand vous voyez quelque chose de “trop beau pour être vrai”. Vérifiez si les caractéristiques esthétiques, de qualité magazine, sont compatibles avec le contexte dans lequel la photo est censée avoir été prise. La leader d’une manifestation au maquillage impeccable ? La victime d’une catastrophe naturelle qui n’a pas un cheveu qui dépasse ? Un moment politique improvisé, où tout le monde semble avoir été relooké par un styliste ? Vous devez être immédiatement sur vos gardes.

- Avez-vous le sentiment que quelque chose est trop parfait ? La personne semble-t-elle trop apprêtée / parfaite ?

- Déterminez s’il y a un décalage avec le contexte : L’apparence des personnes – style magazine – détonne-t-elle dans un contexte de crise ou de conflit ?

- Procédez à un examen minutieux de la peau : Y a-t-il une irrégularité gommée là où on s’attendrait à voir un grain de peau naturel ?

- Réalisez une évaluation générale du contexte : L’apparence de la personne correspond-elle à la situation ?

Vérification technique en cinq minutes (infos ordinaires) : Cet examen plus approfondi porte sur les détails techniques qui trahissent un contenu artificiel. L’IA moderne crée des images parfaites anatomiquement, mais elles affichent souvent une perfection troublante que l’on ne trouve pas sur les photos réelles. En effet, les photos réelles de visages réels présentent des asymétries subtiles, des signes de vieillissement naturel et des effets environnementaux que l’IA a du mal à reproduire de manière réaliste.

- Zoomez à 100 % sur les visages : Essayez de déterminer si le grain et les pores de la peau sont naturels, et de détecter des asymétries même mineures.

- Evaluation de la physique des vêtements : Froissage naturel, texture du tissu et usure par endroits, ou pas ?

- Analyse des mèches de cheveu : Mèches individuelles visibles, ou chevelure qui semble avoir été créée avec MS Paint, à l’inverse d’une véritable photo ?

- Réalisme des bijoux et accessoires : Apparence en trois dimensions, ou planéité des graphiques, telle que générée par l’IA ?

- Examen des dents : Imperfections naturelles ou perfection uniforme ?

- Evaluation générale : L’apparence générale correspond-elle au contexte et à l’endroit invoqués ?

Enquête approfondie (reportage aux enjeux importants) : Quand la fiabilité d’une information est fondamentale, cette analyse exhaustive traite l’image comme s’il s’agissait d’une preuve nécessitant un examen technico-légal. Le but est d’évaluer, à partir de plusieurs points de vérification, la réalité d’une information. Et de bien intégrer que l’on peut toujours avoir un jugement avisé, même quand il n’est pas possible de se reposer sur des preuves irréfutables.

- Analyse comparée : Trouvez d’autres photos de la même personne pour comparer son apparence naturelle et celle présentée.

- Grossissement technique : Utilisez des outils professionnels pour examiner le grain de peau au niveau pixel pour détecter d’éventuels modèles mathématiques.

- Vérification du contexte : Effectuez des recherches et comparez avec d’autres images pour déterminer si la personne présente toujours la même apparence lisse dans des contextes similaires.

- Consultation de professionnels : Contactez des experts en analyse technico-légale numérique, comme Farid Hany, pour leur demander une analyse approfondie.

- Vérification sous plusieurs angles : Essayez de trouver d’autres photos ou vidéos du même événement pour vérifier la cohérence du contenu.

- Comparaison historique : Comparez avec des photos authentifiées de la personne qui datent de la même époque ou qui ont été réalisées dans le même contexte.

Catégorie 2 : Non respect de la géométrie — Quand l’IA défie les lois naturelles

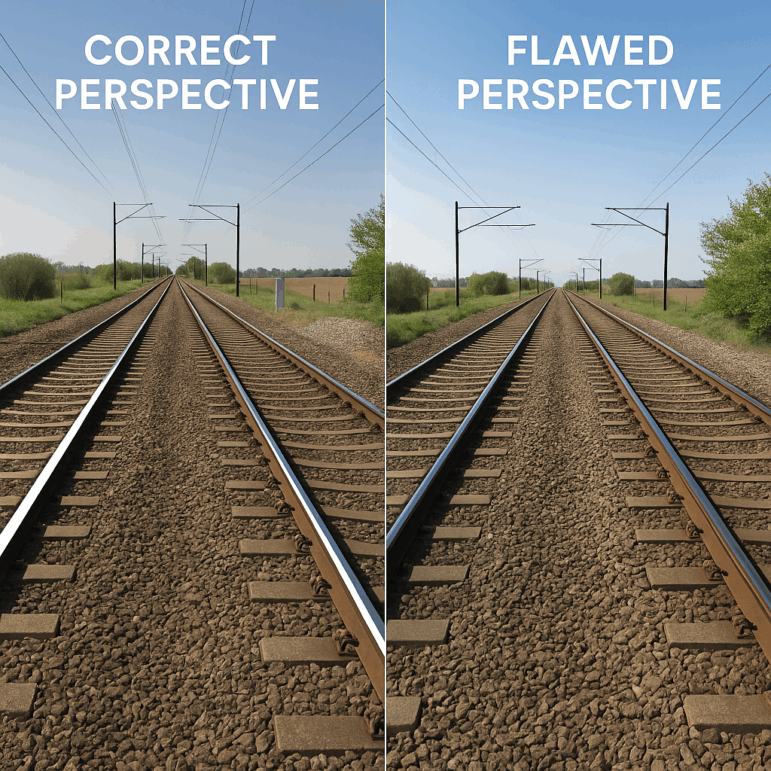

A droite, une image de voies ferrées qui disparaissent à l’horizon générée par l’IA et, à gauche, l’image authentique d’une perspective exacte. Images : Henk van Ess

Le narratif : L’IA assemble les images comme s’il s’agissait d’un collage, et non d’une photographie. Elle intègre facilement les éléments visuels mais ne comprend pas les règles géométriques et physiques qui régissent la manière dont la lumière, la perspective et les ombres se combinent dans la réalité. Ces erreurs physiques fondamentales sont plus difficiles à éviter pour l’IA parce qu’elles nécessitent de comprendre l’espace 3D et la façon dont la lumière est réfléchie.

Les problèmes de la physique, dans toutes les images d’IA : Bien que nous ne soyons qu’au début de l’ère de l’IA générative, les images artificielles corrigent les ombres et les reflets en fonction de la perspective. Prenons un exemple type, généré par DALL-E 2, de OpenAI, avant correction. On constate que les ombres manquent de cohérence, que les reflets ne sont pas du tout coordonnés voire même manquants, et que les ombres observables dans les reflets sont orientées dans la mauvaise direction.

Analyse du point de fuite : Dans la vraie vie, les bâtiments suivent les lois de la perspective : des lignes parallèles convergent vers un point unique à l’horizon. L’IA crée souvent des bâtiments dont les lignes des toits sont orientées par exemple vers la gauche, alors que les lignes des fenêtres sont orientées vers la droite, une impossibilité physique révélatrice de l’intervention d’un algorithme, et qui prouve qu’il ne s’agit pas d’une photo. Les points de fuite jouent un rôle fondamental pour saisir la perspective. Les images générées par l’IA comportent souvent des incohérences, par exemple quand les lignes ne se rencontrent pas exactement au point de fuite.

Vérification de la cohérence des ombres : Quand il y a de la lumière, il y a des ombres. La relation entre un objet, son ombre, et la ou les sources de lumière est simple, d’un point de vue géométrique, mais il est beaucoup plus difficile qu’on ne le croit d’atteindre la perfection dans une image modifiée ou créée. Dans les cas où il y a une seule source de lumière (la lumière du soleil, par exemple), toutes les ombres doivent être orientées à l’opposé de cette source. Or, quand on utilise l’IA, les ombres des personnes sont souvent orientées dans différentes directions, même s’il n’y a qu’une source de lumière, défiant ainsi les lois de la physique.

Validation de la recherche : La recherche universitaire confirme ces ratés géométriques. Des études réalisées à l’aide de GradCam sur des images censées avoir été prises en extérieur révèlent que les ombres des véhicules sont orientées dans différentes directions et qu’il y a des distorsions structurelles à proximité des points de fuite, tandis que les images soi-disant prises en intérieur comportent des incohérences entre les objets et leurs ombres, ainsi que des lignes mal alignées en termes de géométrie.

Il faut faire preuve de persévérance pour pratiquer ce type de détection subtile. Prenez l’habitude de bien examiner les lignes avant toute chose.

Vérification urgente en 30 secondes :

- Trouvez n’importe quelle photo de voies ferrées (tapez dans Google “perspective de voies ferrées”).

- Ouvrez un éditeur d’images.

- Utilisez l’outil de création de lignes pour prolonger les deux rails vers l’horizon.

- Vérifiez qu’elles convergent bien vers un point unique : c’est ce qui DEVRAIT se passer.

Vous avez maintenant un modèle visuel d’une perspective exacte.

Vérification technique en cinq minutes (infos ordinaires) :

Test de perspective :

- Choisissez UN SEUL bâtiment figurant sur l’image.

- Utilisez n’importe quel éditeur d’images pour prolonger les lignes de toit et les rangées de fenêtres.

- Vérifiez si les lignes de ce même bâtiment convergent vers un point unique.

- Vous constatez plusieurs points de fuite pour une seule structure ? Il y a erreur d’assemblage par l’IA.

Analyse des ombres :

- Identifiez la source primaire de lumière (surbrillances).

- A partir de cette source, prolongez les lignes supérieures des objets jusqu’à l’extrémité des ombres.

- Vérifiez que toutes les ombres sont bien orientées dans la même direction.

- Si vous observez des ombres orientées dans plusieurs directions, c’est contraire aux lois de la physique.

Enquête approfondie (reportage aux enjeux importants) :

Vérification des reflets : Quand les objets sont réfléchis sur une surface plane, les lignes qui relient un point de l’objet au point correspondant dans le reflet doivent converger vers un seul point de fuite.

- Identifiez les surfaces réfléchissantes de l’image (eau, verre, miroirs).

- Dessinez des lignes qui relient les objets à leurs reflets.

- Vérifiez si les lignes rejoignent la surface réfléchissante aux angles droits.

- Si vous constatez des positions de reflets impossibles, cela signe un raté géométrique.

Catégorie 3 : Signatures techniques & analyse des pixels — L’ADN mathématique

Le narratif : Quand l’IA crée une image, elle laisse dans son sillage des indices dans le fichier. Une signature mathématique qui est comme une empreinte digitale invisible que seuls des outils spécialisés sont en mesure de détecter. Ces indices concernent la manière dont les pixels sont organisés et dont le fichier est compressé. Un peu comme une preuve génétique qui démontrerait qu’une image a été réalisée par l’IA et non prise avec un appareil photo.

Détection de “neige” : Les vrais appareils photo prennent des images qui comportent des imperfections naturelles, de minuscules mouchetures aléatoires dont le capteur de l’appareil est responsable. Les images générées par l’IA, au contraire, présentent un aspect parfait. Quand les experts analysent cet aspect à l’aide d’un logiciel spécialisé, ils voient des formes distinctives semblables à des étoiles, formes qui n’apparaîtraient jamais sur une vraie photo. Un phénomène comparable à la différence entre la “neige” totalement aléatoire d’un vieux poste de télévision, et un ordinateur qui essaie de reproduire cette “neige”. La version artificielle a un ordre caché qui la trahit, si vous disposez des outils adéquats.

Détection de copié / collé : Quand l’IA ou une personne reproduit certaines zones d’une image, on obtient des assemblages de pixels inhabituels. Différentes parties de l’image sont similaires au point d’en être suspectes, au-delà d’une redondance naturelle, ce qui crée des motifs détectables ou des signatures mathématiques.

Analyse des artefacts de compression : Les contenus générés par l’IA comportent souvent des motifs de compression artificiels qui diffèrent des fichiers bruts issus d’un appareil photo, ce qui révèle des origines algorithmiques et non optiques.

Outils de détection professionnels : La technologie TrueMedia.org a la capacité d’analyser les médias suspects et d’identifier les infox audio, image et vidéo. Parmi les exemples d’infox signalés récemment par TrueMedia.org, on notera deux photos, l’une censée montrer l’arrestation de Donald Trump et l’autre représenter Joe Biden avec des militaires haut gradés.

Vérification urgente en 30 secondes :

Avant d’analyser des images suspectes, entraînez-vous sur un document fiable :

- Importez votre photo dans Image Verification Assistant.

- Cet outil vous dira s’il risque de s’agir d’un faux, et à quelle probabilité.

- Faites une recherche plus poussée sur l’image si ce taux est égal ou supérieur à 70 %.

Vérification technique en cinq minutes (infos ordinaires) :

- Vérification visuelle de la texture : Zoomez à 100 % sur certaines zones, de la peau ou une partie de ciel, par exemple. Examinez le grain de peau ou l’apparence du ciel. Observez-vous des zones hétérogènes, comme dans la vraie vie, ou constatez-vous une trop grande régularité, une perfection quasi mathématique ? Les vraies photos contiennent des éléments de chaos naturel, tandis que l’IA crée souvent des motifs qui sont uniformes et donc suspects.

- Outil de détection automatisée : Importez l’image dans TrueMedia.org (un site gratuit). Cet outil soumet l’image à un logiciel de détection d’IA qui analyse les signatures mathématiques cachées que nous avons évoquées plus haut. Il vous indique la probabilité que l’image ait été générée par l’IA.

- Vérifiez les informations cachées du fichier : Faites un clic droit sur le fichier image et sélectionnez “Properties” (si vous utilisez un PC) ou “Get Info” (pour un Mac). Regardez les métadonnées, pour savoir quel logiciel a été utilisé pour créer le fichier, et quand. Les images générées par l’IA comportent souvent des horodatages du logiciel d’édition ou des outils de création, qui ne correspondent pas à la date ou à la manière dont la photo est censée avoir été prise.

- Analyse de la surface : Cette étape est différente de la vérification de la texture. En effet, il s’agit de surfaces qui devraient être naturellement imparfaites, comme un mur ou de l’eau. L’IA a tendance à “retoucher” ces surfaces, en les rendant lisses au point d’avoir un aspect artificiel, alors que sur une vraie photo, de tissu par exemple, on voit des petites inégalités, des variations, ou de l’usure.

A chaque étape, vous pouvez identifier différents types d’erreurs liées à l’IA. C’est un peu comme si vous réalisiez plusieurs tests différents pour être sûr de votre conclusion.

Enquête approfondie (reportage aux enjeux importants) :

Forensically : Il s’agit d’une série d’outils gratuits, qui permettent d’analyser les bruits de manière exhaustive, et de visualiser le domaine fréquentiel.

Analyse du domaine fréquentiel : Détection technique de modèles mathématiques propres à l’IA.

Catégorie 4 : Artefacts vocaux & audio — Quand les voix de synthèse se trahissent

Le narratif : La technologie de clonage de voix peut reproduire la voix de n’importe quelle personne à partir de quelques secondes d’audio, mais elle laisse des traces qui prouvent qu’il s’agit d’une voix artificielle, dans la manière de s’exprimer, l’authenticité émotionnelle et les caractéristiques acoustiques. Les voix de synthèse atteignent une précision impressionnante, mais elles ont toujours du mal à reproduire certains éléments humains subtils qui rendent un discours vraiment authentique.

Exemples d’imposture audio : En mars 2019, le PDG d’une société énergétique britannique a reçu un appel de son “patron” à l’accent allemand parfait, lui demandant de faire un virement bancaire important. C’est seulement quand il a reçu un second appel, suspect, d’un numéro autrichien, que la supercherie à l’IA a été révélée. Plus récemment, le consultant politique Steven Kramer a payé 150$ pour mettre en place un appel robotisé imitant la voix du président des Etats-Unis de l’époque, Joe Biden, qui exhortait les gens à ne pas aller voter lors de la primaire démocrate dans le New Hampshire en 2024.

Rapidité et coût des faux contenus audio : Selon les poursuites engagées contre Kramer, il a fallu moins de 20 minutes pour créer l’appel robotisé, qui n’a coûté qu’un dollar. Kramer a déclaré à CBS News que son initiative lui avait rapporté “l’équivalent de 5 millions de dollars en termes de publicité”.

Les indices concernant la manière de s’exprimer : Lindsay Gorman, qui étudie les nouvelles technologies et la désinformation, a déclaré à NBC News que l’on trouve souvent des indices dans les infox : « La cadence, en particulier vers la fin, semble robotique, peu naturelle. C’est l’un des signes qui indique potentiellement un contenu audio artificiel.”

- Cadence peu naturelle, sans la respiration et les hésitations normales.

- Prononciation impeccable, sans les imperfections du discours naturel.

- Inflexion robotique sur certains mots ou expressions.

- Absence de bruit ambiant, ce qui est anormal.

- Expressions ou terminologie que la personne n’emploierait jamais.

Erreurs de logique linguistique : Dans une affaire d’infox qui a été mise au jour, l’IA disait “livres sterling 35 000”. Le fait d’indiquer la monnaie avant la somme, de manière peu naturelle à l’oral, en anglais, a permis de détecter un fake.

Vérification urgente en 30 secondes (infos de dernière minute) :

Jetez un coup d’oeil au plugin Hiya Deepfake Voice Detector, proposé par Chrome (vous pouvez l’utiliser 20 fois par mois). Il a passé avec succès le test vidéo Trump-Biden.

Il s’agit d’une extension de Chrome qui analyse les documents audio en temps réel pour déterminer si ce que vous entendez est une vraie voix humaine ou un document créé par l’IA.

Voici ce qu’il fait :

- Il analyse les voix des contenus vidéo et audio que lit votre navigateur Chrome.

- Il obtient un résultat instantanément. Il ne lui faut qu’une seconde d’audio pour se prononcer.

- Il fonctionne quel que soit le site, qu’il s’agisse de plateformes de réseaux sociaux, de sites d’information ou de plateformes vidéo.

- Il détecte les discours ressemblant à ceux d’êtres humains, créés par les principaux outils de voix de synthèse générés par l’IA.

- Il peut analyser plusieurs langues.

- Il fonctionne en temps réel, pendant que vous surfez sur le net.

Mise en garde : Etant donné que ce plugin utilise des algorithmes probabilistes, il ne sera pas fiable à 100 % à chaque fois.

Vérification technique en cinq minutes (infos ordinaires) :

- Essayez de détecter les caractéristiques d’un discours naturel : La cadence et la prononciation vous donnent-elles l’impression que c’est bien un être humain qui parle ?

- Procédez à des vérifications contextuelles : Cette personne a-t-elle pu faire cette déclaration à ce moment-là ?

- Vérifiez l’authenticité émotionnelle : L’émotion exprimée correspond-elle au contenu et au contexte ?

- Appelez le numéro officiel de la personne pour toute vérification audio urgente.

- Posez des questions auxquelles seule la personne concernée peut répondre.

Enquête approfondie (reportage aux enjeux importants) :

- Téléchargez l’intégralité de la séquence audio.

- Copiez-la dans Notta.ai et attendez que la transcription soit prête.

- Pendant ce temps, importez dans Claude cinq ou six séquences audio authentifiées de la même personne ou des transcriptions.

- Demandez-lui de réaliser une analyse sémantique et de classer les thèmes, les habitudes de langage et de grammaire, le style, la tonalité de la voix.

- Importez ensuite la transcription de l’audio qui vous paraît suspect et demandez à Claude de la comparer et de rechercher des anomalies.

Catégorie 5 : Logique temporelle et contextuelle — Quand l’idée générale échappe à l’IA

Le narratif : L’IA crée du contenu qui repose sur des motifs visuels, sans comprendre le contexte du monde réel, la logique temporelle ou la pertinence d’une situation. Ce qui génère des contenus qui sont convaincants pris isolément, mais qui ne sont pas cohérents si on les examine en faisant preuve de simple bon sens.

La tromperie de la vidéo sur une prison en Iran : Une vidéo sophistiquée, générée par l’IA, était censée montrer une frappe de missiles israélienne sur la prison d’Evin, en Iran, en juin 2025, mais elle avait été générée à partir d’une photo de 2023. Parmi les principaux indices de détection, on compte les décalages saisonniers (des arbustes sans feuilles sur des images censées avoir été tournées en été), une correspondance parfaite de détails qui défie les probabilités, et un timing impossible.

Vérification urgente en 30 secondes (infos de dernière minute) : L’IA crée des contenus convaincants, au niveau visuel, mais des liens logiques fondamentaux lui échappent souvent entre le timing, le lieu, et les circonstances. Quand il s’agit d’informations de dernière minute, fiez-vous à votre propre connaissance du monde réel pour déceler immédiatement des impossibilités qui nécessiteraient une analyse complexe si elles devaient être vérifiées plus tard.

- Vérifications saison / météo : La végétation, la lumière et les vêtements correspondent-ils à la date et au lieu invoqués ?

- Vérification de l’époque en termes de technologie : Y a-t-il des appareils, des véhicules ou des infrastructures qui sont anachroniques ?

- Avez-vous le sentiment que quelque chose ne va pas au niveau géographique ? L’architecture, la signalétique et le paysage correspondent-ils au lieu invoqué ?

- Evaluation éclair de la crédibilité des sources : L’origine du contenu est-elle en adéquation avec sa qualité et avec les conditions d’accès ?

Vérification technique en cinq minutes (infos ordinaires) : Cette analyse plus approfondie sollicite vos compétences pour confronter les affirmations et les faits vérifiables. L’IA a du mal avec la nature interconnectée des événements du monde réel, et elle crée des contenus qui peuvent passer avec succès un examen visuel mais qui ne résistent pas à un examen logique, quand on les compare à des sources de données externes.

- Vérification de la météo : Vérifiez les archives météo en fonction des dates et des lieux invoqués, et comparez-les aux conditions météo apparentes.

- Vérification des points de repère architecturaux : Vérifiez que les bâtiments, les panneaux et les infrastructures visibles existent bien à l’endroit invoqué.

- Analyse des éléments culturels : Confirmez que le style de vêtements, les comportements et la dynamique sociale sont en adéquation avec le contenu géographique et culturel.

- Evaluation de l’époque : Faites des recherches pour déterminer si, en toute logique, les différents événements invoqués ont pu avoir lieu au même moment.

- Enquête sur les sources : Examinez la manière dont le contenu se propage, en comparaison avec les modèles de distribution habituels pour des événements similaires.

- Recherche angles multiples : Recherchez d’autres documents sur le même événement, auprès de sources indépendantes.

Enquête approfondie (reportage aux enjeux importants) : Pour les informations d’importance critique, traitez les indices liés au contexte comme autant de pièces d’un puzzle technico-légal, chacune d’entre elles nécessitant une vérification systématique, en la comparant avec des faits avérés. Cette approche globale constitue une matrice de probabilité qui repose sur plusieurs incohérences, plutôt que sur des arguments irréfutables isolément.

- Reconstitution exhaustive des éléments de temps : Etablissez une chronologie détaillée des événements invoqués, et recoupez tous les éléments visuels.

- Vérification des données géographiques : Utilisez les images satellite, Street View, et les services d’experts locaux pour confirmer les détails du lieu concerné.

- Expertise technico-légale saisonnière / environnementale : Consultez des experts en botanique, des météorologistes et des sources locales sur les conditions environnementales.

- Evaluation de l’authenticité culturelle : Interviewez des experts régionaux sur les normes comportementales, les us et coutumes ainsi que les codes vestimentaires.

- Analyse des anachronismes techniques : Vérifiez que tous les appareils, les véhicules et les infrastructures visibles existaient bien au moment et à l’endroit invoqués.

- Enquête sur les sources : Retracez l’historique complet de la distribution du contenu et comparez avec d’autres exemples pour essayer de retrouver des événements similaires et authentiques.

- Réseau de consultation d’experts : Contactez les journalistes locaux, les universitaires et les autorités publiques qui connaissent bien le lieu ou la situation invoqués.

- Réalisation d’une matrice de probabilité : Accordez une note à chaque élément logique et réalisez une évaluation complète de l’authenticité du contenu.

Catégorie 6 : Reconnaissance du comportement — Quand l’IA ne comprend pas l’être humain

Le narratif : L’IA peut reproduire l’apparence humaine mais elle a du mal avec les comportements humains authentiques, la dynamique sociale et les modes d’interaction naturels. Cela crée des incohérences décelables dans les scènes de groupe, les dynamiques de groupe et les comportements individuels que les observateurs qui ont suivi une formation sont en mesure de détecter.

Vérification urgente en 30 secondes (infos de dernière minute) : L’IA crée des images de foules qui ont une apparence réaliste à première vue, mais dont les comportements peu naturels trahissent le manque d’authenticité. Quand il s’agit d’infos de dernière minute, demandez-vous si les gens se conduisent comme des personnes le feraient dans ces circonstances, et non comme des acteurs numériques dont le comportement a été programmé.

- Examen de l’uniformité de la foule : Y a-t-il trop de personnes de la même classe d’âge, qui ont une apparence physique ou un style vestimentaire similaires ?

- Vérification de l’attention : Est-ce que tout le monde regarde l’appareil photo ou dans la même direction, ou bien y a-t-il les variations qu’on serait en droit d’attendre ?

- Avez-vous l’intuition qu’il n’y a pas d’authenticité émotionnelle ? Les expressions des visages sont-elles en adéquation avec l’ambiance et l’intensité supposées de l’événement ?

- Evaluation du réalisme des mouvements : Les espaces entre les personnes et leur langage corporel sont-ils naturels, ou bien ces personnes ont-elles été positionnées de manière artificielle ?

Vérification technique en cinq minutes (infos ordinaires) : Cette analyse fait appel à votre compréhension de la dynamique sociale, pour identifier les erreurs de l’IA quand elle cherche à reproduire un comportement de groupe authentique. Dans la réalité, on trouve dans les foules des modes de comportement complexes que les données d’entraînement de l’IA ne peuvent pas saisir pleinement, ce qui crée une uniformité artificielle décelable dans des images de rassemblements censés avoir été improvisés.

- Evaluation de la diversité démographique : Identifiez les classes d’âge et les styles vestimentaires, et évaluez la représentation ethnique. Constatez-vous une homogénéité improbable ?

- Examen des interactions sociales : Les conversations, les relations et la dynamique de groupe sont-elles authentiques, ou les personnes ont-elles été mises en scène ?

- Vérification des réactions à l’environnement : Les gens réagissent-ils de manière proportionnée à la météo ambiante, à la lumière, aux bruits ?

- Examen du comportement culturel : Les normes sociales, l’espace entre les personnes et leurs modes d’interactions sont-ils en adéquation avec le contexte invoqué ?

- Analyse de l’expression individuelle : Essayez de repérer des expressions particulières sur les visages, ainsi que des émotions authentiques. Ou bien ne voyez-vous que des réactions uniformes ?

- Evaluation du réalisme des mouvements : Constatez-vous des asymétries naturelles et des singularités, ou bien des mouvements sans à coups, artificiels ?

Enquête approfondie (reportage aux enjeux importants) : Pour les informations d’une importance critique, considérez les comportements humains comme des éléments de preuves qui nécessitent une analyse systématique des modèles sociaux. Cette approche exhaustive vous permet de déterminer si la trame complexe des interactions humaines est compatible avec les circonstances invoquées.

- Analyse sociologique de la foule : Consultez des experts en psychologie de foule pour vérifier si la dynamique de groupe est réaliste, vu le type d’événement.

- Vérification de l’authenticité culturelle : Interviewez des spécialistes régionaux sur les comportements sociaux, les codes vestimentaires et les modes d’interaction. Sont-ils adaptés à la situation ?

- Evaluation démographique : Effectuez des recherches pour déterminer si la composition de la foule correspond à la norme pour le même genre d’événement.

- Examen technico-légal des comportements individuels : Analysez quelques personnes en particulier pour essayer de trouver des personnalités et des relations cohérentes, ainsi que des réactions émotionnelles authentiques.

- Etude de l’adaptation à l’environnement : Vérifiez si les réactions de la foule à la météo, au bruit et à la logistique correspondent à ce qui peut se passer dans la réalité.

- Comparez avec d’autres événements : Comparez avec des images vidéo ou des photos authentifiées, prises lors d’événements similaires qui ont eu lieu dans la même région ou dans le même contexte.

- Consultation d’experts : Contactez des anthropologues, des sociologues et des journalistes locaux qui connaissent bien la dynamique sociale de la région.

- Analyse des micro-expressions : Consultez des experts pour leur demander d’examiner les expressions sur les visages et d’essayer de détecter des réactions émotionnelles authentiques ou, au contraire, générées artificiellement.

- Utilisation des réseaux sociaux : Retracez les relations entre individus pour vérifier l’authenticité de la formation du groupe ou, au contraire, faire la preuve d’un rassemblement artificiel.

Catégorie 7 : L’intuition — Le bon vieux système de détection

Le narratif : Nos cerveaux ont développé une capacité de reconnaissance sur plusieurs millions d’années. Les modèles de l’IA proviennent de données d’entraînement et de processus algorithmiques. Quand quelque chose ne correspond pas aux attentes naturelles, conformes à la perception humaine, l’intuition est souvent le détecteur le plus rapide et le plus fiable, avant de procéder à une analyse technique.

Quand l’IA est démasquée : En 2019, des utilisateurs de réseaux sociaux ont immédiatement signalé une image virale qui avait pour légende “street shark” (“requin des rues”) lors de l’ouragan Florence, aux Etats-Unis. L’image était correcte, d’un point de vue technique, mais les personnes qui l’ont vue ont eu le sentiment qu’il y avait quelque chose qui n’allait pas. Or leur instinct ne les a pas trompés. Des recherches inversées ont révélé qu’il y avait eu une insertion numérique. Les journalistes expérimentés savent reconnaître les images tournées par des amateurs quand elles semblent avoir une trop grande qualité cinématographique pour être vraies, ou encore quand des événements censés avoir eu lieu spontanément font l’objet d’une documentation parfaite.

Fait amusant : pendant plus d’une décennie, plusieurs fakes similaires impliquant un requin ont été publiés suite à des ouragans, mais il y a bel et bien eu un cas qui a été authentifié.

Vérification urgente en 30 secondes : Fiez-vous à votre expérience quand vous disposez de très peu de temps. Identifiez-vous un paradoxe relatif à la qualité ? Par exemple, un film amateur qui serait digne de productions hollywoodiennes ? Ou bien notez-vous un timing opportun, alors qu’il s’agit d’événements prétendument chaotiques pourtant parfaitement documentés ? Votre bon vieux système intuitif repère souvent ce genre de paradoxes, avant que l’analyse technique ne vienne les confirmer.

- Première impression : Avez-vous le sentiment qu’il s’agit de quelque chose d’authentique ou d’artificiel ? (Fiez-vous à un éventuel sentiment de malaise par rapport aux représentations artificielles d’êtres humains, sentiment que l’on appelle également “vallée troublante”.)

- Paradoxe du coût de la production : Un film amateur présente-t-il la qualité adéquate ? (Pour 8$, il est désormais possible de créer de toutes pièces des scandales politiques qui ont l’air professionnel, n’est-ce pas ?)

- Vérification du timing : La documentation parfaite des événements est-elle trop rapide pour un enregistrement réel ?

- Test de la manipulation des émotions : Le contenu est-il conçu dans le seul et unique but de provoquer une réaction émotionnelle chez le lecteur – et donc un partage rapide – plutôt que de l’informer ?

Vérification technique en cinq minutes (infos ordinaires) : Faites confiance à votre intuition et effectuez une vérification systématique en examinant les éléments spécifiques qui vous ont paru suspects, grâce à votre expérience. Quand votre instinct vous dit que quelque chose ne va pas, identifiez ce qui vous gêne puis adoptez une démarche logique.

- Vérification approfondie de la logique du contexte : Le scénario est-il sensé, vu votre connaissance de la réalité ?

- Investigation sur la crédibilité des sources : L’origine du contenu est-elle compatible avec la sophistication technique et avec les conditions d’accès ?

- Analyse du narratif : Les informations s’alignent-elles trop parfaitement avec les tensions politiques ou sociales actuelles ?

- Audit des incohérences techniques : La qualité, l’éclairage ou l’audio correspondent-ils aux circonstances invoquées ?

- Répertoriez les erreurs : Documentez les éléments spécifiques qui vous paraissent douteux ou impossibles en fonction du contexte.

- Evaluation du manque d’adéquation entre la source et le contenu : Signalez les contenus trop sophistiqués pour des amateurs ou des sources anonymes, sans explication.

Enquête approfondie (reportage aux enjeux importants) : Pour les informations d’importance critique, considérez que votre intuition est le point de départ d’une vérification exhaustive. Vous avez identifié des anomalies, grâce à votre expérience. Examinez ensuite de manière systématique chacun des éléments qui vous a paru suspect pour réaliser une évaluation fondée sur des preuves.

- Examen technico-légal : Répertoriez tous les éléments qui vous paraissent suspects puis déterminez en quoi chacun d’entre eux ne correspond pas à ce vous êtes en droit d’attendre.

- Enquête sur les paradoxes de la production du contenu : Estimez les ressources qui auraient été nécessaires, en réalité, et comparez-les avec les capacités d’un amateur.

- Analyse de l’impossibilité contextuelle : Effectuez une comparaison entre les scénarios en présence et les faits concrets, avec l’aide des experts que vous aurez consultés.

- Evaluation de la manipulation des émotions : Analysez la structure du contenu pour identifier d’éventuels éléments déclencheurs viraux conçus spécialement dans cette optique. Ou, au contraire, s’agit-il d’un partage d’information naturel ?

- Recherche d’incohérences techniques : Analysez les décalages en termes de qualité, d’éclairage et d’audio, image par image.

- Vérification de l’authenticité des sources : Enquêtez pour savoir si l’origine invoquée a pu, raisonnablement, produire ce contenu.

- Détection relative à la construction du narratif : Examinez la manière dont l’information est construite, pour tenter d’identifier des aspects artificiels. Ou, au contraire, l’enchaînement des événements vous paraît-il naturel ?

- Consultation d’experts pour identifier des incohérences : Demandez l’aide d’enquêteurs expérimentés dans les évaluations indépendantes et intuitives.

- Analyse du seuil de confiance : Documentez les éléments qui vous paraissent suspects et qui justifient que l’on rejette le contenu malgré sa qualité technique.

Quand faire confiance à votre intuition :

- Quand plusieurs éléments vous paraissent suspects, même si vous ne pouvez pas identifier de problèmes spécifiques.

- Quand un contenu suscite en vous une réaction émotionnelle immédiate, cela veut dire qu’il a été conçu pour vous dissuader de l’analyser.

- Quand la source, le timing ou le contexte révèlent des incohérences.

- Quand la qualité technique ne correspond pas au niveau d’expérience de la personne qui a soi-disant créé le contenu.

- Quand votre cerveau détecte un paradoxe sur la qualité du contenu ou un timing dont vous avez démontré l’opportunité.

La réalité : Pas de solutions parfaites

Conclusion : Ces sept catégories de moyens de détection de l’IA et le nouvel outil — ratés anatomiques, non respect des lois de la physique, signatures techniques, artefacts vocaux, logique contextuelle, modes de comportement et intuition — fournissent un arsenal exhaustif aux journalistes qui travaillent avec des délais serrés pour qu’ils puissent évaluer l’authenticité de contenus. Associés à des outils de détection professionnels et à des règles éditoriales actualisées, ils peuvent nous permettre de rester crédibles. Luttez contre le feu avec le feu. Utilisez l’IA pour détecter l’IA. Et contribuez ainsi à préserver ce qui subsiste de notre réalité partagée.

Traduction de l’anglais : Béatrice Murail

Le Néerlandais Henk van Ess s’attaque à l’IA pour trouver des informations dans les données. Il applique sa technique à l’investigation et met au point des outils à l’usage du public, comme SearchWhisperer et AI Researcher. Formateur dans les rédactions du monde entier, notamment le Washington Post, Axel Springer, la BBC et DPG, il gère Digital Digging, où le renseignement de source ouverte (RSO) fait face à l’IA. Il est assesseur pour le Réseau international de vérification des faits (IFCN) de Poynter et du Réseau européen des normes de vérification des faits (EFCSN, European Fact-Checking Standards Network).

Le Néerlandais Henk van Ess s’attaque à l’IA pour trouver des informations dans les données. Il applique sa technique à l’investigation et met au point des outils à l’usage du public, comme SearchWhisperer et AI Researcher. Formateur dans les rédactions du monde entier, notamment le Washington Post, Axel Springer, la BBC et DPG, il gère Digital Digging, où le renseignement de source ouverte (RSO) fait face à l’IA. Il est assesseur pour le Réseau international de vérification des faits (IFCN) de Poynter et du Réseau européen des normes de vérification des faits (EFCSN, European Fact-Checking Standards Network).

This article first appeared on Global Investigative Journalism Network and is republished here under a Creative Commons license.